WaveFile.hは既にプロジェクトに追加されているはずです。

NtKinect.hをincludeする前に USE_AUDIO 定数をdefineします。 setSkeleton()の後で setAudio(true)を呼び出すとアレイマイクにより音声の方向が計算され、 方向が一致する骨格情報の skeletonTrackingId が audioTrackingId に代入されます。

| main.cpp |

#include <iostream> #include <sstream> #define USE_AUDIO #include "NtKinect.h" using namespace std; void doJob() { NtKinect kinect; cv::Mat beam; while (1) { kinect.setRGB(); kinect.setSkeleton(); kinect.setAudio(true); for (int i=0; i<kinect.skeleton.size(); i++) { int w = 10; cv::Scalar color = cv::Scalar(0,0,255); if (kinect.audioTrackingId == kinect.skeletonTrackingId[i]) { w = 20; color = cv::Scalar(0,255,0); } for (auto joint: kinect.skeleton[i]) { if (joint.TrackingState == TrackingState_NotTracked) continue; ColorSpacePoint cp; kinect.coordinateMapper->MapCameraPointToColorSpace(joint.Position,&cp); cv::rectangle(kinect.rgbImage,cv::Rect((int)cp.X-w/2,(int)cp.Y-w/2,w,w),color, 2); } } cv::imshow("rgb", kinect.rgbImage); kinect.drawAudioDirection(beam); cv::imshow("beam", beam); auto key = cv::waitKey(1); if (key == 'q') break; } cv::destroyAllWindows(); } int main(int argc, char** argv) { try { doJob(); } catch (exception &ex) { cout << ex.what() << endl; string s; cin >> s; } return 0; } |

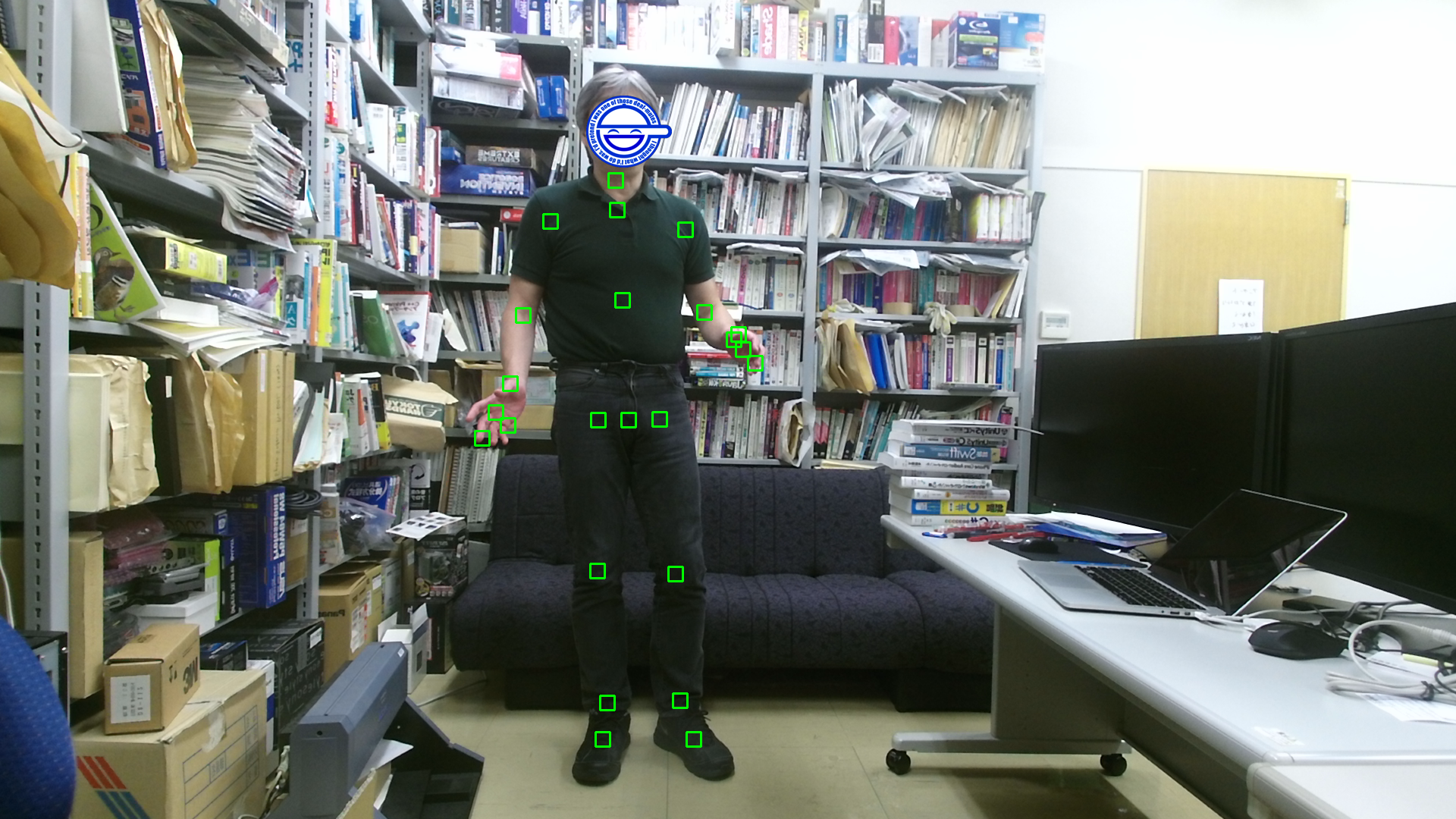

関節が赤い四角形で描画されますが、発話者の関節は緑の四角形で描画されます。

音声方向を別ウィンドウで表示しているのは確認のためだけで、この部分はなくても構いません。

上記のzipファイルには必ずしも最新の NtKinect.h が含まれていない場合があるので、 こちらから最新版をダウンロードして 差し替えてお使い下さい。